Fausser l’information journalistique pour mobiliser les algorithmes et les publics : comment les plateformes permettent-elles de faire du vrai avec du faux ?

Résumé

Afin d’étudier la circulation des fake news en ligne, cet article propose une analyse info-communicationnelle du traitement endogène et automatisé des contenus journalistiques sur les médias socio-numériques dans un contexte de controverse environnementale. Regarder ce qui est fait avec ces contenus pour mobiliser des publics à soutenir une cause permet de définir une typologie de pratiques visant tant à les mettre en contexte qu’en circulation. Les contenus journalistiques étant eux-mêmes standardisés pour maximiser l’audience sur les plateformes, ils deviennent le meilleur moyen d’informer, de mobiliser comme de désinformer, sans avoir nécessairement à les reproduire de manière factice. La désinformation en ligne apparait ainsi comme une conséquence de la plateformisation de l’information et de la communication qui l’autorise voire la renforce.

Mots clés

Désinformation ; Plateformisation ; Contenus journalistiques ; Fake news ; Astroturfing

In English

Title

Faking the news to engage algorithms and audiences. How do platforms allow to make fake with real?

Resume

In order to study the online circulation of fake news, this article presents an info-communicational analysis of the endogenous and automated processing of journalistic contents on social media in a context of environmental controversies. Examining what is done with these contents to engage audiences in supporting a cause allows us to define a typology of practices designed to both contextualize and circulate them. As journalistic contents are themselves standardized to maximize the platform audience, they become the best way to inform, mobilize as well as disinform, without necessarily having to reproduce them in a fake way. Online disinformation thus appears because of the platformization of information and communication, which authorizes and even reinforces it.

Keywords

Disinformation; Platformization; Journalistic content; Fake news; Astroturfing

En Español

Título

Distorsionar las noticias para movilizar algoritmos y audiencias. ¿Cómo permiten las plataformas convertir lo falso en real?

Resumen

Para estudiar la circulación de noticias falsas en la red, este artículo propone un análisis infocomunicacional del tratamiento endógeno y automatizado de los contenidos periodísticos en los medios de comunicación socionuméricos en un contexto de controversias medioambientales. El examen de lo que se hace con estos contenidos para movilizar al público en apoyo de una causa permite definir una tipología de prácticas destinadas tanto a contextualizarlos como a hacerlos circular. A medida que el contenido periodístico se estandariza para maximizar la audiencia en las plataformas, se convierte en la mejor forma de informar, movilizar y desinformar, sin tener que reproducirlo necesariamente de forma falsa. La desinformación en línea parece ser una consecuencia de la plataformización de la información y la comunicación, que la autoriza e incluso la refuerza.

Palabras clave

Desinformación; Platformización; Contenido periodístico; Noticias falsas; Astroturfing

Pour citer cet article, utiliser la référence suivante :

Alloing Camille, , « Fausser l’information journalistique pour mobiliser les algorithmes et les publics : comment les plateformes permettent-elles de faire du vrai avec du faux ? », Les Enjeux de l’Information et de la Communication, n°23/5, 2023, p.47 à 68, consulté le mercredi 1 avril 2026, [en ligne] URL : https://lesenjeux.univ-grenoble-alpes.fr/2023/supplement-a/03-fausser-linformation-journalistique-pour-mobiliser-les-algorithmes-et-les-publics-comment-les-plateformes-permettent-elles-de-faire-du-vrai-avec-du-faux/

Introduction

« On peut tromper une personne mille fois. On peut tromper mille personnes une fois. Mais on ne peut pas tromper mille personnes, mille fois. » (Émile). Certaines analyses tendent à contredire cette célèbre citation du film La cité de la peur (Berbérian, 1994). Nous serions dans une « ère » de la « post-vérité » où la défiance envers ceux qui nous informent n’a d’égal que la nécessité d’armer nos esprits pour survivre à une dangereuse, mais inévitable « apocalypse cognitive » 1. Ces états des lieux alarmistes s’appuient sur un constat discutable et discuté : la désinformation en ligne repose sur une volonté de tromper d’un côté, et d’y croire de l’autre, les fake news sont avant tout le fait d’individus répondant à un agenda politique précis. A contrario, il est possible d’envisager les phénomènes de désinformation en ligne comme le corollaire des fonctionnalités de création, d’agencement et de détournement des informations offertes par les plateformes. Désinformer ne repose plus alors seulement sur une intention de tromper et de produire du faux.

En effet, les opérations de mise en relation « systématique entre des faits ou des situations » (Quéré, 2000, p. 339) permettant de produire de l’information sont nombreuses sur les plateformes dites de médias socio-numériques, comme leurs opérateurs. Ce qui nous informe repose tout d’abord sur des algorithmes qui vont structurer de manière semi-automatisée les données que nous égrainons, et sur des interfaces ensuite, dont les affordances et les standards orientent nos pratiques info-communicationnelles. Enfin les autres usagers des plateformes contribuent à contextualiser l’information par leurs commentaires et par leurs interactions qu’ils soient des « amis », des « followers », ou encore des journalistes, des scientifiques, des militants… Dès lors, les contenus informationnels s’adaptent aux contextes dans lesquels vous et moi les consommons et dans lesquels nous interagissons. Lorsque nous souhaitons qu’ils soient lus, nous pouvons les modeler, les déformer, les reformer, pour qu’ils s’accordent au mieux aux standards des plateformes et aux attentes des publics. C’est alors cet incessant travail documentaire, mais aussi affectif lorsque l’on cherche à émouvoir pour attirer l’attention, qui participe à dés-informer.

Dans le cas de mobilisations sociales et citoyennes, la coordination des actions nécessaires comme la multiplicité des contenus informationnels diffusés laisse parfois penser à une forme de manipulation. En particulier lorsque les enjeux sont localisés, qu’ils reposent sur une expérience que l’on souhaite transmettre, une argumentation que l’on veut rendre visible, ou une cause qui ne souffre aucune contestation. Ce qui est le cas des mobilisations qui seront évoquées dans cet article. Qui me prouve que ce qui est dit est vrai ? Est-ce vraiment une personne concernée qui s’exprime ? Cette mobilisation est-elle spontanée ou simulée ? Et comment observer ce « faux » alors qu’il est possible de ne pas s‘identifier formellement sur les plateformes ?

Plutôt que de chercher le vrai sur des plateformes qui autorisent le faux, je propose d’analyser la réappropriation par des militants des contenus produits par les médias et leurs journalistes afin d’observer les possibles tactiques amenant à désinformer. Ma problématique se formule par cette question : de quelle manière certaines pratiques info-communicationnelles de mobilisation en ligne permises par les plateformes instrumentalisent-elles les contenus journalistiques pour (dés)informer les publics ?

Pour répondre à ce questionnement, je présente, dans une première partie, une synthèse de la littérature sur la « plateformisation », les mobilisations en ligne, la désinformation et l’astroturfing. Cette synthèse m’amène à considérer l’étude de la désinformation en ligne à trois niveaux : les plateformes, les pratiques et les contenus. Puis, après avoir exposé mon terrain dans une deuxième partie, à savoir des pages Facebook de mobilisation contre l’implantation de parcs éoliens en France et les contenus qui y sont partagés, je discute les résultats de leur analyse dans une troisième partie. Trois répertoires de pratiques nécessaires à la mobilisation anti-éolienne en France, et qui ont pour particularité de faire appel à du contenu journalistique pour appuyer leur propos. Je souligne la manière dont ces pratiques participent ou non à désinformer et à mettre en circulation de possibles fake news.

Les fake news entre mobilisations et plateformisation

Gilets jaunes, #Metoo, #Blacklivesmatter… Les mobilisations sociales ou politiques se coordonnant par et sur les médias socio-numériques se multiplient depuis une quinzaine d’années (Boyer et al., 2018). Qu’elles soient de grande ampleur, ou plus discrètes, locales ou internationales, ponctuelles ou continues, ces mobilisations supposent une cause à défendre et un public à mobiliser (Carlino et Mabi, 2017). Le public n’est pas nécessairement militant, et son engagement ou adhésion va varier en fonction du registre émotionnel employé dans les messages mobilisateurs (Granjon, 2017), de l’identification à cette mobilisation (ibid.), des fonctionnalités des dispositifs utilisés (Akrich et Méadel, 2007), et de l’organisation de l’action : individuelle ou collective, coordonnée ou non (Badouard, 2013). Le partage de contenus (liens hypertextes, images, vidéos, actualités, pétitions, etc.) est un moteur de ces mobilisations, particulièrement sur les médias socio-numériques où leur circulation élargit ainsi le public potentiel (ibid.). Émerge en creux la question –micro- de la véracité de ces contenus, comme celle –méso- de l’authenticité des publics qui se mobilisent pour les faire circuler (Bennett et Livingston, 2018). Au niveau macro, celui des environnements numériques, « la mobilisation en ligne est encadrée par la dynamique de production de la valeur économique sur les plateformes du web » (Sedda, 2021).

Cette dynamique peut être qualifiée de plateformisation lorsque les modèles (économiques, techniques, etc.) des plateformes deviennent hégémoniques (Rieder et Sire, 2014 ; Helmond, 2015) et s’imposent aux acteurs marchands ou médiatiques (Amiel et Joux, 2020). La plateforme « se rapporte à un modèle d’organisation de la médiatisation, composé d’une architecture sémio-technique, d’un ensemble d’opérateurs d’activation et de régulation des activités des usagers comme des contenus proposés et d’un mode de valorisation propres » (Bullich et Lafon, 2019. La relation asymétrique entre les plateformes et les « plateformisés » n’est pas qu’économique, elle est aussi communicationnelle. L’usage des plateformes génère une dépendance « puisque les modalités d’actions sont sous l’emprise du dispositif, de ses affordances et de ses règles » (Alloing et al., 2021, p. 163). Cette dépendance ne se limite pas qu’aux acteurs organisationnels ou médiatiques (Sebbah et al., 2020), elle s’observe pour chaque usager qui souhaite publier ou interagir avec des contenus en ligne. Les affordances sont la « propriété d’un objet ou un trait de l’environnement immédiat qui indique quelle relation l’usager doit instaurer avec l’objet, comment il doit s’en servir, ce qu’il doit faire avec » (Paveau, 2012, p. 53). Elles se matérialisent par des éléments de design à la fois signes et fonctionnalités, comme un #hashtag ou un bouton « j’aime ». Ces affordances délimitent et orientent les gammes d’actions possibles (Marwick et Boyd, 2011) comme acheter, dialoguer, partager, etc. Pour les usagers, ces fonctionnalités permettent de produire de l’autorité (Alloing, 2017), du contexte (Costa, 2018) et du sens par la personnalisation des contenus mis en circulation. Pour éviter que ces usages nuisent à la dynamique économique des plateformes, des règles sont clairement édictées dans les conditions générales d’utilisation. Les algorithmes des plateformes sanctionnent ou valorisent alors le respect qui en est fait par divers mécanismes de mise en visibilité ou d’invisibilisation (Alloing et al., 2021). Par conséquent, pour se coordonner et pour que les contenus et messages nécessaires à une mobilisation soient médiatisés, il faut faire avec cette plateformisation, ses modèles, ses standards, ses règles et ses affordances, tout en essayant de les instrumentaliser, de les détourner et de les contourner.

Dans des environnements numériques où ce qui émeut est ce qui fait cliquer (Alloing et Pierre, 2017), où ce qui est cliqué est ce qui est mis en visibilité et où ce qui circule agrège de nouveaux publics (Paulhet et al., 2022), la question des contenus est fortement liée à celle de la plateformisation. Se mobiliser pour une cause peut alors amener à relayer des rumeurs sur une plateforme comme Twitter dont le design et les fonctionnalités favorisent leur circulation (Alloing et Vanderbiest, 2018). Si ce relai est non intentionnel, il participe à une forme de mésinformation (Vraga et Bode, 2020). La possibilité d’ajouter des éléments à un message, de tronquer une information que l’on partage, ou simplement d’y ajouter une opinion (Kapantai et al., 2021) conduit à déformer ou à reformer un message véridique. À l’inverse, s’il s’agit de la « fabrication d’un faux message puis à sa diffusion de façon qui semble neutre et dans un but stratégique » (Huyghe, 2016, p.63), nous sommes face à de la désinformation : une fake news est alors mise en circulation.

Considérant que la désinformation est un acte délibéré, la fake news suppose elle aussi une intention de tromper. Elle provient « de groupes minoritaires ou marginaux » (Giry, 2021, p. 385) et fait preuve d’une véridicité variable (Wardle et Derakhshan, 2017). Il est possible d’en établir une typologie qui se compose des actualités satiriques, des parodies d’actualités, de la fabrication d’une information simulant une production journalistique, de la manipulation d’images ou de vidéos, ou encore de publireportages non signalés (Tandoc et al., 2018). Cette expression apparait néanmoins comme « polysémique, confuse, simpliste et peu opératoire » en comparaison à celles de rumeur et de propagande (Dauphin, 2019, p.28). En se limitant au registre de la vérité, elle affaiblit la possibilité de qualifier finement les situations de communication, les contextes numériques de circulation des messages et les cadres sociotechniques de leur production. En mettant en exergue l’importance de l’intentionnalité, elle participe à hiérarchiser les émetteurs (Doutreix et Barbe, 2019) avec d’un côté les autorités informationnelles traditionnelles qui commettraient des erreurs et, de l’autre, les internautes lambda ou militants qui auraient une intention de nuire. Pourtant, différentes autorités participent à rendre crédibles et visibles ces fake news, même si elles n’en sont pas à l’origine : qu’elles soient journalistiques (Alloing et Vanderbiest, 2018), algorithmiques (Broudoux et Ihadjadene, 2021), ou réputationnelles comme les « influenceurs ». Partant du constat que « l’information acquiert une signification, devient « informationnelle » dans ce processus qui lie étroitement un traitement et son résultat » (Mayer, 1990, p.285), et qu’en ligne ce traitement repose autant sur les algorithmes et sur les standards que les usages, il parait donc judicieux de ne pas seulement s’intéresser à l’intention et à la véracité. La désinformation peut alors être considérée comme un ensemble de pratiques permises par le processus de traitement de l’information inhérent aux plateformes. Un processus qui autorise à déformer et à reformer sans cesse des messages, à décontextualiser et à recontextualiser des contenus standardisés pour favoriser leur circulation. Que ces contenus soient produits par des professionnels de l’information, des publics profanes, militants … ou par des usagers factices dans le cas de l’astroturfing.

L’astroturfing vise à « créer l’impression qu’une certaine opinion ou un certain message est hautement crédible, en prétendant qu’il provient d’un grand nombre d’individus indépendants et sans lien entre eux, alors qu’en réalité, tout cela est le résultat d’un effort coordonné par une source centralisée » (Chan, 2022) 2. Il s’appuie en ligne sur un répertoire d’action défini (Kovic et al., 2018) : pétitions, achats de profils en ligne, création de bots, faux profils, faux commentaires, etc. Il favorise des actions de désinformation en ayant recours ou non à des fake news (Lits, 2021). Dans le cadre de l’étude sur les mobilisations en ligne, l’astroturfing amène à s’interroger sur l’identité des entités produisant ou mettant en circulation l’information (Keller et al., 2020). Mais comme pour les fake news ou la désinformation, la relation au faux n’est pas binaire : « l’astroturfing est un phénomène complexe et souvent hybride dans le sens où certaines organisations partagent à la fois des attributs grassroots [i.e. authentiques] et astroturf » (Lits, 2021, p.132). Là encore, les fonctionnalités des plateformes et la (non)application de leurs règles permettent à n’importe qui de se masquer partiellement (anonymat des profils, possibilité de changer de nom ou de pseudonyme et de créer plusieurs comptes). C’est alors la coordination d’actions présentées comme spontanées et militantes par des entités non identifiables ou factices qui prévaut dans la qualification d’une action comme étant de l’astroturf (Boulay, 2015).

En synthèse, analyser des mobilisations sociales numériques en s’interrogeant sur ce qu’elles génèrent comme possible désinformation se réalise par un prisme info-communicationnel à trois niveaux :

Micro, celui des contenus produits : comment sont-ils produits ou agencés, et par qui ? Quelle véracité ? Quelle mise en contexte ?

Méso, celui des acteurs qui les produisent, les font circuler, interagissent : quelle autorité pour les publics qui se mobilisent ? Sont-ils identifiables ? Quelle mode d’organisation ?

Macro, celui de la plateformisation de la communication : quels usages des fonctionnalités proposées par la plateforme où l’on se mobilise ? En quoi sont-ils encadrés par les standards et par les règles de cette plateforme ? Quelle régulation algorithmique ?

Ces questions guident l’analyse du corpus constitué de publications visant à mobiliser les individus contre l’implantation d’éoliennes en France.

Enquêter en ligne sur la résistance aux éoliennes

L’enquête s’inscrit dans un projet de recherche financé par un industriel français de l’énergie 3. L’une des questions posées par celui-ci était la suivante : quelles sont les dynamiques communicationnelles qui participent aux controverses et aux mobilisations contre l’implantation de parcs éoliens ? L’objectif est d’analyser les pratiques et les arguments appuyant la résistance à l’énergie éolienne, en particulier en ligne où de nombreux acteurs parfois difficilement identifiables semblent se coordonner, tout du moins interagir. La constitution des corpus de cette étude se fonde sur une méthode quali-quantitative, constituée d’une ethnographie numérique (Hine, 2000) et de l’analyse de données YouTube.

La démarche ethnographique a tout d’abord consisté à identifier cinq pages Facebook de mobilisation contre l’implantation de parcs éoliens à un niveau communal. Le choix de ces pages a été décidé selon trois critères : la localisation en Nouvelle-Aquitaine des projets éoliens contestés, une activité de publication hebdomadaire depuis au moins 6 mois, comprenant a minima 15 publications. Sur ces pages, j’ai analysé dans une grille ad hoc 4 les 157 publications publiées depuis leur création jusqu’au 1er avril 2019. Puis, à partir des contenus partagés, j’ai identifié dix nouvelles pages aux objectifs similaires, et poursuivi l’analyse de 245 publications. Je me suis ensuite concentré sur les contenus et sur les sources que ces quinze pages ont en commun, ce qui m’a permis d’identifier des articles, des vidéos, des pétitions, des tweets, et des sites web dont les contenus sont partagés de manière récurrente. Ce sont ces contenus qui vont ici servir d’illustration pour présenter mes analyses.

Les vidéos étant la catégorie de contenu la plus présente, avec les pétitions et les articles de presse, j’ai choisi par la suite de sélectionner la plus partagée sur ces pages Facebook, en l’occurrence un reportage du média Brut 5. À partir de ce reportage, j’ai identifié les autres vidéos que YouTube lui associe, c’est-à-dire qui apparaissent à côté de ladite vidéo comme des recommandations. J’ai pour cela utilisé l’outil YouTube Data Tools et son Video Network Module (Rieder, 2015). Avec une profondeur de crawl de 1, l’outil a proposé 501 vidéos que l’algorithme de YouTube met donc en relation avec celle réalisée par Brut. J’ai ensuite classé ces vidéos en fonction de leurs arguments : pour le recours à l’éolien en France (15 sur 501), contre le développement de l’éolien (75), le traitement journalistique se voulant équilibré (vidéos produites ou diffusées par des médias -91), et autre (publicité et vulgarisation scientifique principalement). 27 vidéos avec un coefficient de clustering élevé, autrement dit des vidéos accessibles à moins de 2 « clics » les unes des autres, ont été gardées pour analyse. Ces vidéos soit sont produites par un média français, soit sont des montages ou des détournements de reportages afin d’appuyer des arguments anti-éoliens.

Les résultats de cette collecte m’ont permis de définir trois répertoires de pratiques de traitement des contenus journalistiques utiles à la mobilisation anti-éolienne : enquêter pour produire ses propres contenus à partir de données ou informations accessibles en ligne, affecter la circulation de contenus journalistiques existants en renforçant leur charge émotionnelle lors de leur diffusion, et influencer les publics comme les acteurs qui se mobilisent en leur fournissant des contenus décontextualisés à mettre en circulation.

Enquêter, affecter, influencer : trois manières de mobiliser (par) les contenus journalistiques

Les pages Facebook sont tenues par des groupes, souvent associatifs (11 pages sur 15), s’inscrivant dans un territoire donné, et dont les pratiques informationnelles reposent avant tout sur le partage d’actualités, de vidéo et de pétitions. Une même vidéo –par exemple- va ainsi circuler d’une page à une autre, dans un phénomène plus proche du mimétisme que de la réelle coordination. La publication est parfois personnalisée pour la lier aux contextes de chaque acteur, mais pour autant il y a peu d’interactions dans les commentaires entre les membres des diverses pages. Parfois, une page en cite une autre pour signaler d’où provient le contenu partagé (Figure 1), ou encore pour inciter ses membres à signer des pétitions. Mais, globalement, ces pages ont peu d’abonnés (200 en moyenne), peu d’interactions, et aucune dans notre corpus ne centralise l’ensemble des contenus ou des actions.

Figure 1. Exemple du partage d’une publication d’une page (140 abonnés) par une autre (448 abonnés)

Ce rôle centralisateur semble cependant dévolu à une entité qui apparait systématiquement comme une ressource pour chaque page 6: ni association, ni entreprise, elle est apparemment gérée par un seul individu et propose un site web traduit en quatre langues avec de nombreuses ressources, des liens vers un ensemble d’associations locales ou internationales de lutte contre l’éolien et plus généralement contre les énergies dites renouvelables.

Au niveau des contenus, la typologie est la suivante :

Les contenus produits par ces acteurs eux-mêmes ou d’autres. Ils proviennent d’enquêtes et d’analyses menées à partir de données ouvertes (comme celles référencées par geo.data.gouv.fr), de travaux d’expertises et de publications journalistiques. Ces productions peuvent être aussi plus triviales (chants, affiches humoristiques) ;

Les contenus journalistiques (vidéos et articles essentiellement), dont la mise en circulation repose sur une contextualisation par un registre affectif ou de contestation ;

Les productions journalistiques et scientifiques (recontextualisées ou décontextualisées), modifiées ou provenant de sources douteuses, comme certaines revues scientifiques dites « prédatrices » (Cobey et al., 2018). Ces contenus sont alors mis à disposition des acteurs des mobilisations, ou sont diffusés directement sur des plateformes comme YouTube.

La mise en circulation de ces contenus s’associe donc à des pratiques informationnelles nécessaires à leur agencement et leur adaptation aux objectifs de chaque acteur. C’est alors dans ces agencements que se nichent de possibles formes de désinformation.

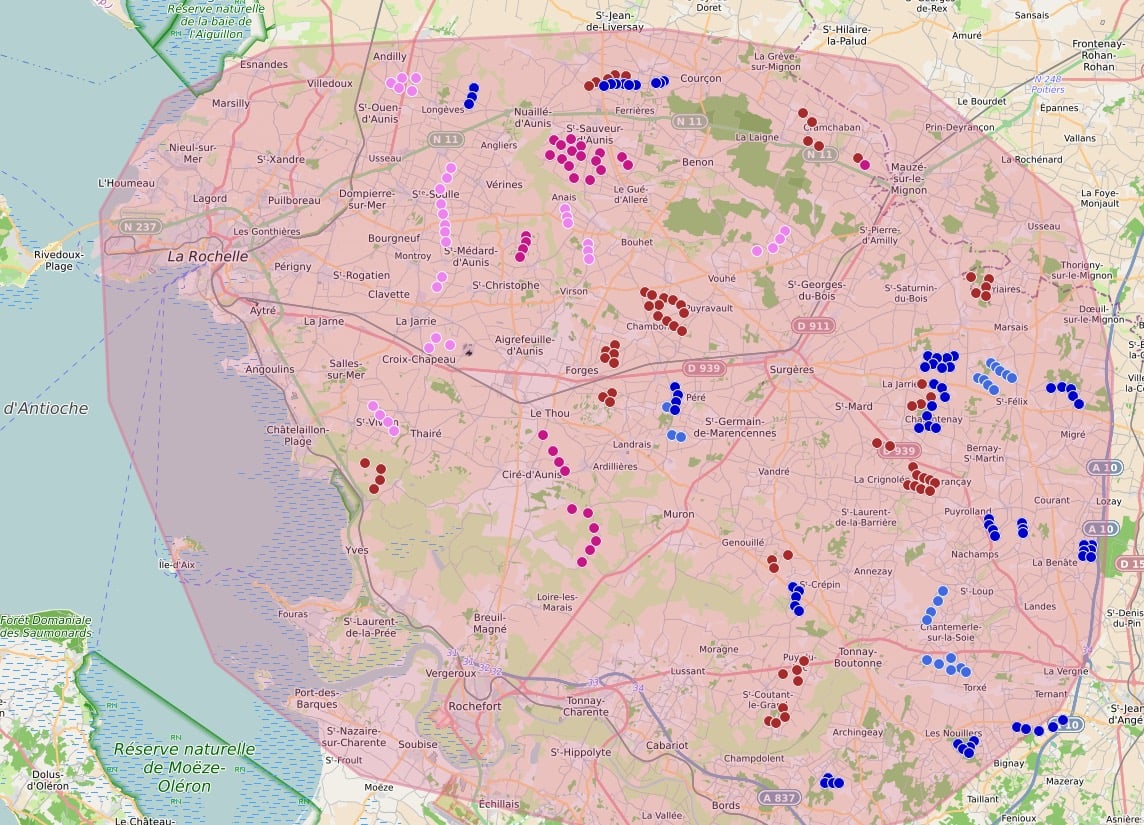

Enquêter pour produire ses propres contenus

La mobilisation par l’enquête s’inscrit dans un travail de traitement de l’actualité et des données disponibles afin d’informer les publics ou de convaincre les élus en les interpellant par la suite en ligne ou non. Dans une logique d’ouverture des données et de travail collaboratif, certains acteurs associatifs identifiés vont ainsi s’appuyer sur des dispositifs spécifiques pour structurer et partager les données collectées (Figure 2).

Figure 2. Carte (OpenStreet Map) des projets en cours, prévus ou achevés d’implantation de parcs éoliens sur la communauté d’agglomération de La Rochelle.

L’auteur de la carte (Figure 2) est anonyme, il est donc difficile de définir son autorité et son expertise sur la question, ou encore les données utilisées. Néanmoins, une association dont les membres sont identifiables en revendique la création. Outil d’information, cette carte est avant toute chose un moyen de générer des discussions en ligne et de mobiliser les individus potentiellement concernés et qui ne sont pas informés de ces implantions. Ce travail de recherche et d’agrégation de données accessibles en ligne peut s’avérer rigoureux et s’identifie dans d’autres mobilisations comme celles contre la vaccination (Lee et al., 2021). Mais ce travail peut potentiellement désinformer et à être à l’origine de rumeurs (voire en résulter) quand l’analyse et la mise en corrélation d’informations déjà constituées ne s’appuient pas sur une démarche ouverte ou collaborative (Figure 3).

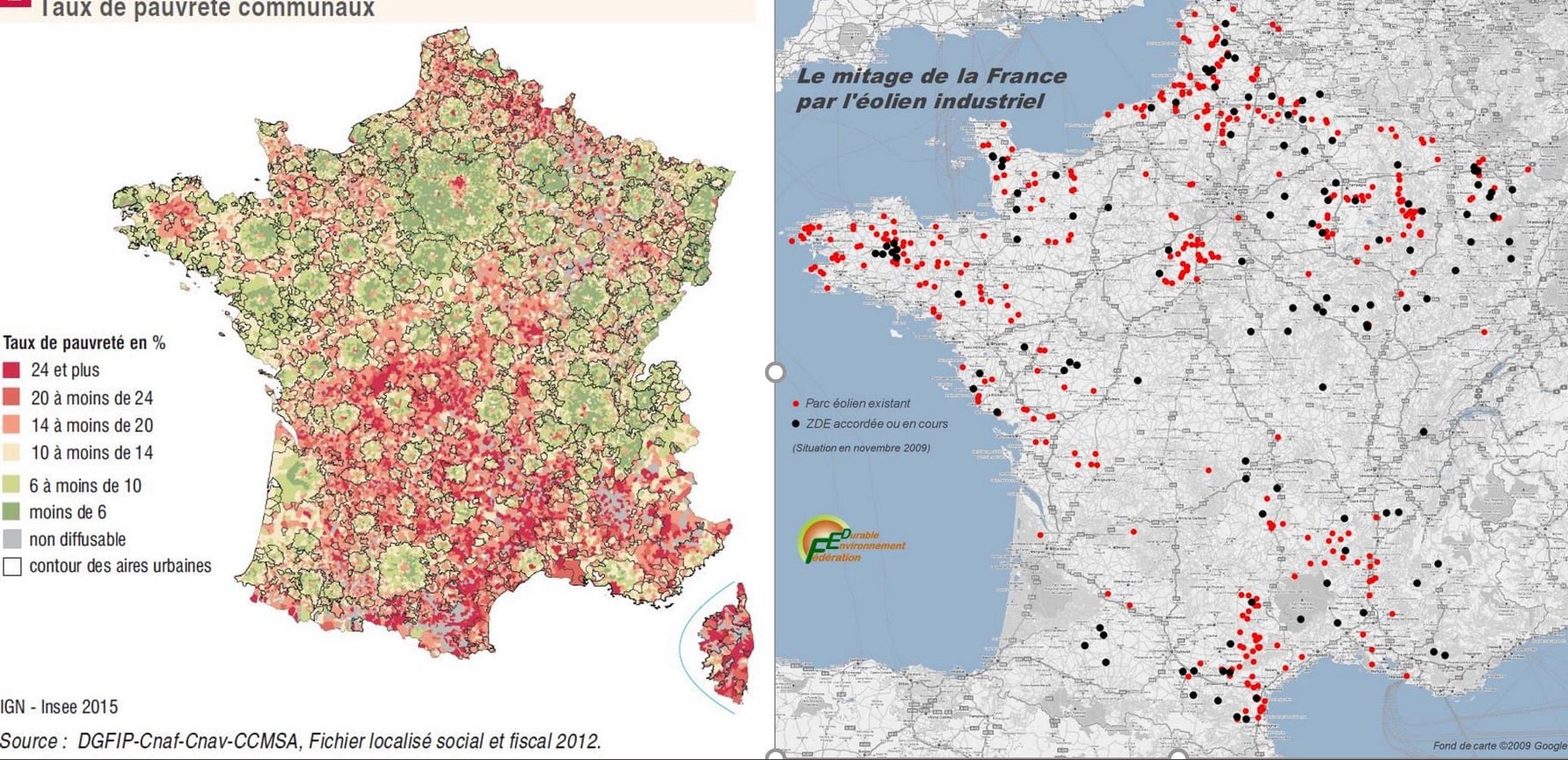

Figure 3. Mise en relation de deux cartes dans une seule image : la première montrant le taux de pauvreté communaux (DGFIP) et la seconde la répartition des parcs éoliens en France (FEO).

Dans ce cas, les cartes proviennent de sources fiables, mais leur mise en relation sous-tend l’existence d’un phénomène qui n’est pas corroboré par des études scientifiques. Là encore, il n’est pas possible d’identifier clairement les auteurs de ce montage puisque les plateformes où il est mis en circulation ne l’exigent pas. Dans notre corpus, cette image est relayée par une association créée par un conseil municipal refusant l’implantation d’éoliennes sur son sol. Il est donc possible que les publics, surtout les plus mobilisés, lui attribuent une certaine autorité.

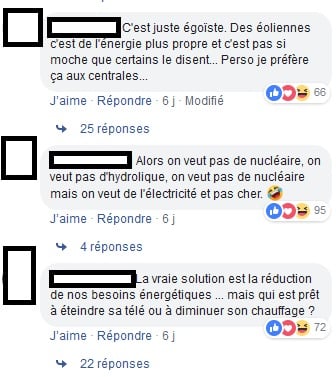

Enfin, dans la même lignée, certaines actualités sont contredites par la citation d’études sans renvoi vers des sources, dans un registre argumentatif de défiance visant à remettre en question un travail d’enquête journalistique (Figure 4).

Figure 4. Publication Facebook reproduisant un commentaire écrit sur le site 20minutes.fr et citant une étude pour contredire un « FactChecking » du journal.

Le seul article de presse traitant à notre connaissance du « congrès des médecins de mai 2015 à Francfort » et des éoliennes est celui de The Australian 7. L’identification de cette source nécessite d’enquêter ou de faire une veille d’actualité. Cette veille est généralement effectuée par des sites qui agrègent des informations anti-éoliennes. Mais ici, il s’agit aussi d’affecter une audience relativement confidentielle (350 abonnés) afin d’inciter au partage pour accentuer la circulation d’arguments anti-éolienne.

Affecter les contenus pour orienter les publics et les algorithmes

L’enquête la plus médiatisée n’est pas l’œuvre de militants, mais du média Brut (Figure 5).

Figure 5 : vidéo du média en ligne Brut, intitulée « 3 arguments des anti-éoliens »

Cette vidéo reprend les principaux arguments présents dans notre corpus : les éoliennes ne sont ni écologiques ni esthétiques, et les principaux bénéfices financiers vont aux promoteurs. Ici, la légitimité du contenu provient de sa source et appuie fortement les actions de mobilisation des acteurs de l’opposition au développement de l’énergie éolienne. Cette possibilité de faire connaitre ces arguments à de nouveaux publics par le biais d’une source faisant autorité n’a pas échappé au ministre français de l’Écologie de l’époque qui a remis en question les arguments, accusé Brut d’être « démago », et dont le ministère a proposé un fact checking (Figure 6)

Figure 6. Réaction sur Twitter du ministre de l’Écologie et de son ministère à la vidéo Brut.

Pourtant la majorité des commentaires accompagnant cette vidéo sur Facebook ou Twitter sont plutôt ironiques ou réprobateurs face à aux propos qu’elle relaie (Figure 7).

Figure 7. Exemples de commentaires ironiques attachés à la vidéo Brut sur Facebook

Toutefois la propagation de la vidéo dépasse celle de son fact checking (3 400 partages de la vidéo sur Facebook), particulièrement sur les pages anti-éoliennes où les propos du ministère ne sont jamais relayés. Et plus de deux ans après sa diffusion, cette vidéo est régulièrement remise en circulation afin d’inciter à la mobilisation contre de nouveaux projets d’implantation (Figure 8).

Figure 8. Mise en circulation de la vidéo Brut, avec injonction à l’action, plus de deux ans après sa diffusion

Ces partages et injonctions donnent ainsi la possibilité aux acteurs observés d’élargir leurs soutiens en favorisant l’exposition d’un plus grand nombre de public à leurs arguments. C’est d’ailleurs une recommandation explicite de Facebook pour « Accroître l’audience et les interactions sur votre Page » 8. Et de manière générale, dans un contexte de plateformisation des pratiques où les médias socio-numumériques recommandent l’utilisation d’images pour attirer l’attention, le recours à des arguments affectifs et émotionnels s’avère performant en termes d’interactions. Il permet aussi de ne pas avoir à justifier certaines assertions ou l’origine des images elles-mêmes (Figure 9).

Figure 9. Exemple d’un tweet repris sur 7 pages de notre corpus dans lequel des images d’oiseaux possiblement tués par des éoliennes sont montrées et sont associées à des assertions sur les éoliennes.

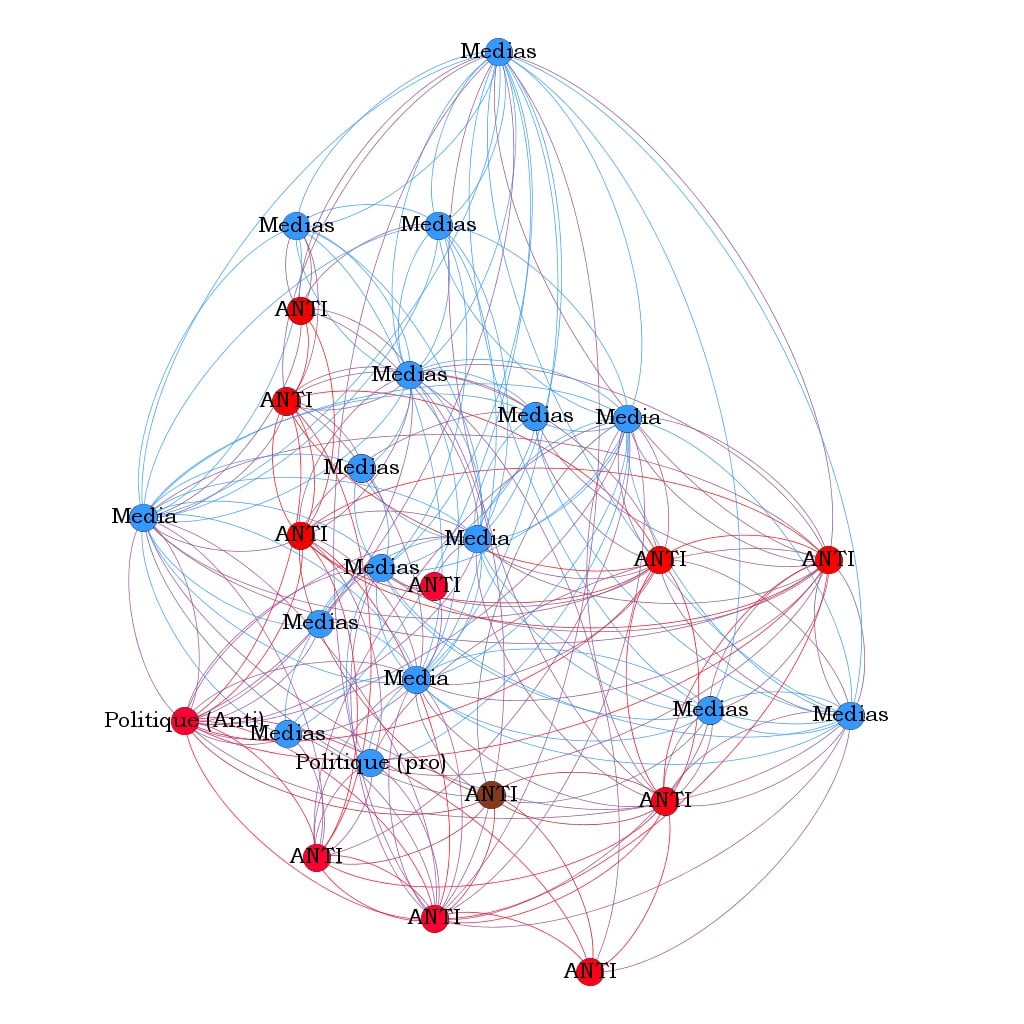

Au-delà de Facebook ou Twitter, YouTube illustre bien cette imbrication de contenus produits par des médias et des contenus mis en ligne ou produits par des acteurs anti-éoliennes (Figure 10) sur les plateformes.

Figure 10. Cartographie des liens de recommandation entre 11 vidéos anti-éoliennes et 16 vidéos produites par des médias. Réalisée avec le logiciel Gephi (Bastian et al., 2009).

Cette cartographie représente sur YouTube les liens de recommandation entre des vidéos contenant des arguments anti-éoliens et des vidéos plus pondérées produites par des médias généralistes (France 3, AFP, etc.). De manière schématique, à partir du visionnage d’une vidéo produite par un média concernant les éoliennes, un usager de YouTube peut se voir recommander rapidement (en moins de 2 clics) une vidéo avec uniquement des arguments anti-éoliens. La porosité entre les discours médiatiques et ceux anti-éoliens est donc très forte sur YouTube. Si la question concerne des publics réduits qui font souvent partie des mêmes cercles, les algorithmes de la plateforme vont néanmoins exposer des publics voulant s’informer sur la question à des vidéos ne présentant que des arguments opposés à l’implantation d’éoliennes. Ces vidéos sont souvent des montages de reportages où ne sont gardés que les aspects négatifs (témoignages, accidents). Elles sont reproduites plusieurs fois sur la plateforme afin d’augmenter leur audience, donc leur influence potentielle sur les représentations que l’on se fait des éoliennes.

Influer sur le contenu pour influencer par le contenu

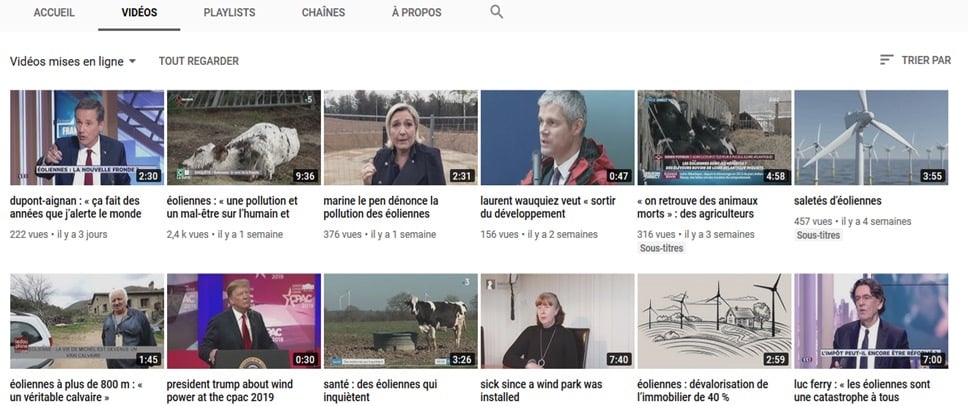

Les collectifs anti-éoliens locaux étudiés ne sont pas des réseaux structurés et coordonnés entre eux, avec des figures d’autorité identifiées. Ce sont des groupes dans lesquels circulent des messages, des dispositifs et des publications utiles à la mobilisation. Peu importe le positionnement politique, la localisation ou la connaissance du domaine, seuls les arguments qui viennent renforcer et s’accumuler à ceux déjà diffusés sont mis en circulation. Par exemple, cette chaine YouTube (Figure 11) avec plus de 1 million de vues en septembre 2022, relaie toute prise de parole anti-éolienne d’acteurs politiques, de Donald Trump à Marine Le Pen, ainsi que tout reportage ou autre contenu vidéo, voire en crée elle-même par le montage d’extraits.

Figure 11. Chaine YouTube de mobilisation contre le développement de l’énergie éolienne active de 2014 à 2019

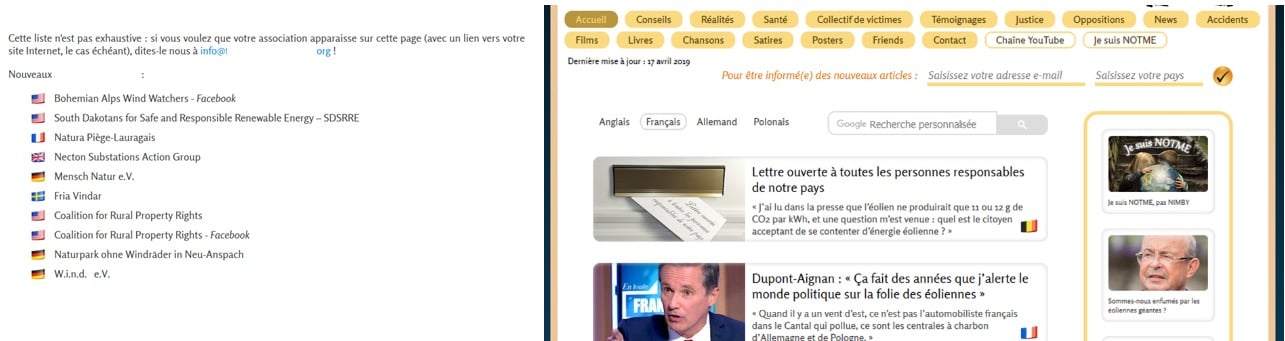

Figure 12. Page d’accueil d’un site web proposant de nombreuses ressources anti-éoliennes, dont une liste d’organisations à travers le monde.

Inactif depuis mai 2020 dans sa version française, ce site met à disposition des contenus journalistiques dont des extraits sont décontextualisés et recontextualisés puis sont ensuite repris tels quels sur les pages Facebook analysées. Ce site est animé par un individu dont le nom est identifiable, même si seule la notion de « collectif » est utilisée. Aucune autre information le concernant n’est accessible hormis quelques signatures sur des pétitions en ligne. Le site est relié à d’autres entités internationales (Figure 13), et apparait d’une qualité bien plus professionnelle que la grande majorité des autres sites anti-éoliens tenus par des collectifs associatifs locaux.

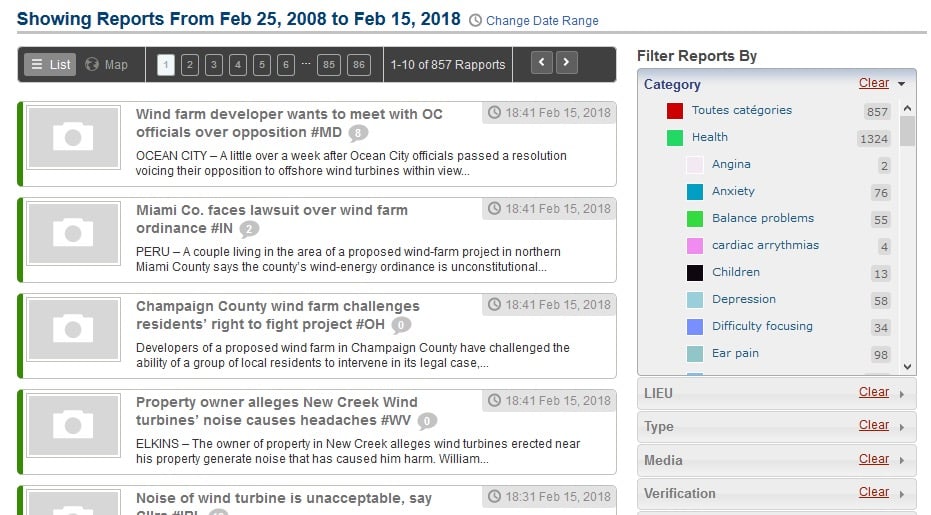

Figure 13. Exemple d’un site web nord-américain (illwind.org), aujourd’hui disparu, et tenu là aussi par des auteurs anonymes. Il recensait des articles de presse et des articles publiés dans des revues scientifiques, dont certaines dites « prédatrices » 9. Ce site permettait de chercher une ressource en fonction des effets présumés des éoliennes sur les individus, du type de média, etc.

Je choisis ici de traiter d’influence, tout d’abord au sens psychosocial du terme. L’objectif de ce site (Figure 12) est de « faire accepter des manières de faire, de ressentir et de penser qui font normes et qui agissent sur les attitudes et les comportements d’autres individus et groupes » (Bernard, 2015, p. 47). Ensuite nous sommes face à des pratiques informationnelles et communicationnelles visant un objectif précis (Alloing et al., 2021b). Ce site fournit les ressources nécessaires aux mobilisations d’autres acteurs. Il intègre aussi leur cause (l’implantation d’éoliennes) à des contestations plus générales (les énergies renouvelables). Par ailleurs, les moyens engagés laissent penser à une stratégie astroturf, comme le fait de ne pouvoir clairement identifier l’auteur du site qui ne cesse de se référer à un « collectif » qui n’a aucune structuration officielle (comme une association loi 1901) tout en revendiquant l’aspect citoyen et spontané de sa démarche.

En somme, ce site agrège les productions journalistiques utilisées pour affecter les publics et accroître l’adhésion, ainsi que les résultats des enquêtes produites par des collectifs identifiés ou non. Il ne met pas à disposition des fake news au sens étroit que leur donne une partie de la littérature, mais il favorise la désinformation en décontextualisant et en ne hiérarchisant ou ne qualifiant pas les contenus qu’il met à disposition.

Faire des contenus journalistiques un instrument pour (des)informer

En synthèse, cet article met en relief l’importance de l’analyse info-communicationnelle du traitement endogène et automatisé des contenus journalistiques pour étudier la désinformation en ligne. Regarder ce qui est fait avec ces contenus pour mobiliser des publics en vue de soutenir une cause permet de proposer une typologie de pratiques. En effet, analyser ces pratiques selon trois niveaux (micro/méso/macro) rend possibles l’identification d’actions de désinformation et la production de fake news par la prise en considération des contextes de production, d’émission et de circulation des contenus, avant même de questionner leur véracité.

Le tableau 1 propose donc de croiser cette typologie de pratiques et ces trois niveaux afin d’éclairer la manière dont certaines pratiques visant à mobiliser des publics pour une cause instrumentalisent les contenus journalistiques.

|

Niveaux / Pratiques |

Enquêter |

Affecter |

Influencer |

|

Micro (contenus) |

|||

|

Agencement des contenus |

Par les militants à partir de données ouvertes |

Par les médias avec ajout d’éléments par les acteurs et par les publics |

Par les diverses entités non identifiables à partir de contenus journalistiques et d’enquêtes militantes |

|

Véracité des contenus |

Questionnable |

Plutôt fiable |

Questionnable |

|

Mise en contexte |

Faible |

Forte |

Instrumentalisée |

|

Méso (acteurs) |

|||

|

Autorité |

Forte pour les publics mobilisés, faible pour les publics non concernés |

Forte pour les publics mobilisés lorsque le contenu soutient la cause, pertinente pour les publics non concernés |

Forte pour les publics mobilisés, faible pour les publics non concernés |

|

Identification |

Partielle |

Possible |

Impossible |

|

Organisation |

Individuelle |

Collective |

Inconnue |

|

Macro (plateforme) |

|||

|

Usage des fonctionnalités |

Intermédiaire (créer des montages photo, des cartographies) |

Ordinaire (cliquer, commenter) |

Avancé (créer de sites web, montage vidéo) |

|

Standards et règles |

Standards techniques (formats des données, des contenus) |

Conditions d’utilisations et règles de modération |

Standards algorithmiques et règles de modération |

|

Régulation algorithmique |

Faible |

Forte |

Instrumentalisée |

Tableau 1. Ce que les stratégies de mobilisation anti-éolienne font aux productions journalistiques selon trois niveaux et trois types de pratiques

Lorsque les acteurs qui se mobilisent souhaitent eux-mêmes informer sur la cause, les sources auxquelles ils font appel font autorité, mais la fiabilité des analyses produites est questionnable, car elles ne sont pas mises en relation avec d’autres travaux similaires. Dans tous les cas, elles seront peu mises en visibilité par les plateformes. Pour favoriser la médiatisation de contenus dans le but de mobiliser des publics non concernés directement (i.e. qui n’ont pas d’éolienne « dans leur jardin »), le recours au registre émotionnel est habituel. Si les contenus proviennent de sources faisant autorité et proposent des informations globalement fiables, cette mise en contexte affective peut générer de la désinformation. Lorsque seuls les témoignages négatifs ou les conséquences néfastes sont exposés sans mise en perspective, la volonté d’affecter pour inciter à faire réagir, donc à cliquer, va détourner le sens premier fourni par les producteurs des contenus. Et lorsque ce traitement ne se limite pas à l’ajout de leviers affectifs, mais bien à la centralisation de ressources manipulées par des entités non identifiables laissant croire à un collectif, le potentiel de désinformation s’avère élevé. Il ne s’agit plus seulement d’influer sur la circulation algorithmique des arguments pour défendre la cause mais bien de faire de cette cause un moyen d’influer plus largement sur un phénomène de grande ampleur, ici les sources d’énergie dites renouvelables.

Le terrain présenté ici permet donc de mieux comprendre la manière dont certaines pratiques info-communicationnelles de mobilisation en ligne permises par les plateformes instrumentalisent les contenus journalistiques pour (des)informer les publics. L’instrumentalisation en question, qu’elle soit intentionnelle ou non, repose avant tout sur des usages répondant aux standards, règles et objectifs économiques des plateformes de médias socio-numériques. Qu’ils souhaitent coordonner des actions de lutte, obtenir du soutien affectif ou influer sur des décisions politiques, les acteurs de la mobilisation anti-éolienne agissent en résonnance avec les modèles des plateformes dans lesquelles ils communiquent : en faisant des contenus journalistiques un levier attentionnel et des publics un levier de propagation.

Conclusion

En analysant les mobilisations contre l’implantation de parcs éoliens en France par le prisme des contenus mis en circulation pour mobiliser les publics et défendre cette cause, plusieurs constats émergent. Les contenus journalistiques sont centraux pour appuyer les messages à véhiculer. Les standards qui dirigent leur production sont reproduits par les acteurs de la mobilisation afin de créer des contenus qui étayent leurs arguments et informent les publics comme les décideurs politiques (mobiliser par l’enquête). Les contenus journalistiques sont aussi utilisés comme un levier pour affecter les publics et les inciter à accentuer la circulation des arguments, voire à adhérer à la cause (mobiliser en affectant les publics). Enfin, ils sont agrégés, décontextualisés, puis proposés comme une « boite à outils » de la mobilisation (mobiliser par l’influence).

Si les pratiques consistant à décontextualiser les contenus journalistiques grâce aux fonctionnalités des plateformes lors de mobilisations sociales ou de controverses participent à désinformer, il est difficile d’y voir systématiquement une intention de nuire ou de manipuler. Elles révèlent cependant que la plateformisation grandissante de notre manière de communiquer et de nous informer semble un facteur central à considérer lorsque l’on s’intéresse aux fake news et à leur circulation. Les contenus journalistiques étant eux-mêmes standardisés pour maximiser l’audience sur les médias socio-numériques, ils deviennent le meilleur moyen de désinformer, sans avoir nécessairement à les reproduire de manière factice. Et les fonctionnalités desdites plateformes, comme leurs standards et leur régulation algorithmiques, étant les mêmes pour tous, chacun peut se prévaloir d’une capacité parfois démesurée à (des)informer. En contrepoint de Hegel, Guy Debord (1992, p.18) l’écrivait : « dans le monde réellement renversé, le vrai est un moment du faux ». Dans des environnements numériques où tout ce qui est spectaculaire devient « viral », il serait renversant de ne pas considérer que le vrai et le faux ne sont pas des unités de sens pour les plateformes, mais le corolaire de ce qui leur permet de produire de la valeur : les clics, les données, les affects et l’attention.

Notes

[1] « Le biais Bronner ou la reductio ad cerebrum » par Dominique Boullier, en ligne : https://aoc.media/opinion/2021/04/08/le-biais-bronner-ou-la-reductio-ad-cerebrum. Consulté le 22/09/2022.

[2] Traduit par l’auteur. Texte original : « It [astroturfing] wants to create the impression that a certain opinion or message is highly credible, by pretending that it comes from a large number of unconnected independent individuals, when in reality it is all the result of a coordinated effort brought about by a centralized source »

[3] Projet « Controverse et résistance au développement de l’éolien. Cartographie de la circulation des discours liés à l’implantation de parcs éoliens en Nouvelle Aquitaine » financé par EDF, codirigé avec Bruno Vétel, avec la participation de Thomas Stenger et Yves Roy du laboratoire CEREGE de l’IAE de Poitiers. En plus des éléments présents dans cet article, cette recherche comprend aussi des observations participantes dans des réunions dites citoyennes, des entretiens qualitatifs avec des acteurs de la résistance à l’implantation d’éoliennes, un questionnaire et une analyse sémantique de commentaires YouTube

[4] Avec des critères comme : le type de publication (vidéos, image, texte, liens hypertextes etc.), la source des informations partagées (presse, sites web, blogs, etc.), la description des contenus partagé, le volume de réactions (« likes », partages, etc.), ou encore les types de commentaires (soutien, partage de ressources, contradiction, témoignage).

[5] « 3 arguments des anti-éolien », par Brut. En ligne : https://youtu.be/sEQxGRR9UDo. Lien consulté le 29/09/2022.

[6] Nous ne la citons pas nommément. Les impressions d’écran présentées ensuite devraient néanmoins permettre aux lectrices et lecteurs de l’identifier.

[7] Article accessible hébergé sur le site officiel du New York State Department of Public Service : https://documents.dps.ny.gov/public/Common/ViewDoc.aspx?DocRefId=%7BDE1BA251-0C09-4508-A977-B5C3D9610B28%7D. Lien consulté le 29/09/2022.

[8] Des conseils comme « Partagez votre Page sur votre fil personnel. Parlez de votre Page à vos ami·es et à votre famille. Dans votre publication, demandez-leur d’aimer votre Page et de la partager avec des personnes susceptibles d’être intéressées (…) ». En ligne : https://www.facebook.com/business/help/464618030623795?id=939256796236247. Page consultée le 29/09/2022.

[9] « Une revue prédatrice (en anglais : predatory journal) est une publication spécialisée, souvent électronique, qui prend les formes d’une revue scientifique sans en présenter toutes les garanties. Elle constitue une escroquerie légale en poussant les chercheurs à payer des frais de publication sans leur fournir les services éditoriaux associés aux revues scientifiques légitimes (en libre accès ou non). ». In Wikipédia, « Revue prédatrice », en ligne : https://fr.wikipedia.org/wiki/Revue_pr%C3%A9datrice. Lien consulté le 18/08/23.

Références bibliographiques

Akrich, Madeleine ; Méadel, Cécile (2007), « De l’interaction à l’engagement: les collectifs électroniques, nouveaux militants de la santé », Hermès, La Revue, n°1, 2007, p. 14553.

Alloing, Camille (2017), « La réputation pour questionner l’autorité informationnelle: vers une « autorité réputationnelle »?, Quaderni. Communication, technologies, pouvoir, (93), p. 33-41.

Alloing, Camille ; Pierre, Julien (2017), Le web affectif. Une économie numérique des émotions, Bry-sur-Marne, INA Éditions.

Alloing, Camille ; Cossette, Samuel ; Germain, Sara (2021), « Faire face aux plateformes. La communication numérique entre tactiques et dépendances », Questions de communication, (40).

Alloing, Camille ; Cordelier, Benoît ; Yates, Stéphanie, (2021), « Pour une approche communicationnelle de l’influence », Communication et organisation. Revue scientifique francophone en Communication organisationnelle, (60), p. 11-20.

Amiel, Pauline ; Joux, Alexandre (2020), « Négocier son rapport aux plateformes: Les représentations des managers de presse locale ». Sur le journalisme, About journalism, Sobre jornalismo, vol. 9, n°1, p. 7487.

Badouard, Romain (2013), « Les mobilisations de clavier », Réseaux, n°5, p. 87117.

Bastian, Mathieu (2009), « Gephi: an open source software for exploring and manipulating networks ». Proceedings of the international AAAI conference on web and social media, vol. 3, n°1, p. 36162.

Bennett, W. Lance ; Livingston, Steven (2018), « The disinformation order: Disruptive communication and the decline of democratic institutions », European journal of communication, vol. 33, n°2, p. 12239.

Boulay, Sophie (2015), Usurpation de l’identité citoyenne dans l’espace public: astroturfing, communication et démocratie, Québec : PUQ.

Boyer, Pierre (2020), « Les déterminants de la mobilisation des Gilets jaunes », Revue économique, vol. 71, n°1, p. 10938.

Bullich, Vincent ; Benoit Lafon (2019), « Dailymotion: le devenir média d’une plateforme. Analyse d’une trajectoire sémio-économique (2005-2018) », Tic&société vol. 13, p. 355-391.

Lits, Brieuc (2021), « Désambiguïsation du concept d’astroturfing et typologie de tactiques astroturfs », ESSACHESS–Journal for Communication Studies, vol. 14, n°1 (27), p. 11536.

Broudoux, Évelyne ; Ihadjadene, Madjid (2021). « Comment la confiance peut-elle s’ exercer dans les «autorités calculées»? » Hermes, La Revue, vol. 88, n°2, 2021, p. 20206.

Carlino, Vincent ; Mabi, Clément (2017), « Mobilisation ». Publictionnaire. Dictionnaire encyclopédique et critique des publics.

Chan, Jovy (2022), « Online astroturfing: A problem beyond disinformation ». Philosophy & Social Criticism, p. 01914537221108467.

Cobey, Kelly D (2018), « What is a predatory journal? A scoping review », F1000Research, vol. 7.

Costa, Elisabetta (2018), « Affordances-in-practice: An ethnographic critique of social media logic and context collapse », New Media & Society, vol. 20, n°10, p. 364156.

Dauphin, Florian (2019), « Les fake news au prisme des théories sur les rumeurs et la propagande ». Études de communication. Langages, information, médiations, n°53, p. 1532.

Debord, Guy (1967), La société du spectacle, Paris : Buchet/Chastel

Doutreix, Marie-Noëlle ; Barbe, Lionel (2019), « Légitimer et disqualifier: les fake news saisies comme opportunité de normalisation du champ journalistique », Études de communication. Langages, information, médiations, n°53, p. 4966.

Giry, Julien (2020), « Les fake news comme concept de sciences sociales ». Questions de communication, vol. 38, n°2, p. 37194.

Granjon, Fabien (2017), « Résistances en ligne: mobilisation, émotion, identité ». Variations. Revue internationale de théorie critique, n°20.

Helmond, Anne (2015), « The platformization of the web: Making web data platform ready », Social media+ society, vol. 1, n°2, p. 2056305115603080.

Hine, Christine (2000), « The virtual objects of ethnography », Virtual ethnography.

Huyghe, François-Bernard (2016), La désinformation: les armes du faux, Paris : Armand Colin.

Kapantai, Eleni ; Christopoulou, Androniki, ; Berberidis, Christos (2021), « A systematic literature review on disinformation: Toward a unified taxonomical framework », New media & society, vol. 23, n°5, p. 130126.

Keller, Franziska ; Schoch, David ; Stier, Sebastian ; Yang, JungHwan (2020), « Political astroturfing on Twitter: How to coordinate a disinformation campaign », Political Communication, vol. 37, n°2, p. 25680.

Kovic, Marko (2018), « Digital astroturfing in politics: Definition, typology, and countermeasures ». Studies in Communication Sciences, vol. 18, n°1, p. 6985.

Lee, Crystal (2021), « Viral visualizations: How coronavirus skeptics use orthodox data practices to promote unorthodox science online », Proceedings of the 2021 CHI conference on human factors in computing systems, p. 118.

Marwick, Alice E., Boyd, Danah (2011), « I tweet honestly, I tweet passionately: Twitter users, context collapse, and the imagined audience », New media & society, vol. 13, n°1, p. 11433.

Mayère, Anne (1990), Pour une économie de l’information, Paris : éditions du CNRS.

Paveau, Marie-Anne (2012), « Ce que disent les objets. Sens, affordance, cognition ». Synergies Pays riverains de la Baltique, n°9, p. 5365.

Quéré, Louis (2000), « Au juste, qu’est-ce que l’information? » Réseaux. Communication-Technologie-Société, vol. 18, n°100, p. 33157.

Rieder, Bernhard (2015), « YouTube data tools ». Computer software. Vers, vol. 1, n°5.

Rieder, Bernhard ; Sire, Guillaume (2014), « Conflicts of interest and incentives to bias: A microeconomic critique of Google’s tangled position on the Web », New media & society, vol. 16, n°2, p. 195211.

Sebbah, Brigitte ; Sire, Guillaume ; Smyrnaios, Nikos (2020), « Journalisme et plateformes : de la symbiose à la dépendance », Sur le journalisme, About journalism, Sobre jornalismo, vol. 9, n°1, p. 611.

Sedda, Paola (2021), « La mobilisation numérique: entre émancipation et rationalisation ». Approches Théoriques en Information-Communication (ATIC), vol. 3, n°2, p. 5374.

Tandoc Jr, Edson C. ; Lim, Zheng Wei ; Ling, Richard (2018), « Defining “fake news” A typology of scholarly definitions », Digital journalism, vol. 6, n°2, p. 13753.

Vraga, Emily K. ; Tully, Melissa ; Bode, Leticia (2020), « Empowering users to respond to misinformation about Covid-19 ». Media and communication (Lisboa), vol. 8, n°2, p. 47579.

Vraga, Emily K. ; Leticia Bode (2020), « Defining misinformation and understanding its bounded nature: Using expertise and evidence for describing misinformation », Political Communication, vol. 37, n°1, p. 13644.

Wardle, Claire ; Derakhshan, Hossein (2017), Information disorder: Toward an interdisciplinary framework for research and policymaking, Council of Europe Strasbourg.

Auteur

Camille Alloing

Camille Alloing est professeur en relations publiques à l’Université du Québec à Montréal (UQAM). Il est directeur du Laboratoire sur l’influence et la communication (Labfluens) et chercheur au Laboratoire sur la communication et le numérique (LabCMO). Ses travaux portent sur les mécanismes de production et de circulation de l’information dans les environnements numériques.

alloing.camille@uqam.ca